ちょき☆ぱたん お気に入り紹介 (chokipatan.com)

第1部 本

社会

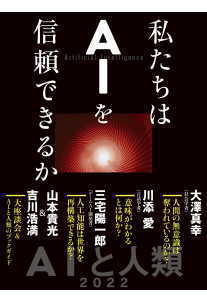

私たちはAIを信頼できるか(大澤真幸)

『私たちはAIを信頼できるか』2022/9/13

大澤 真幸 (著), 川添 愛 (著), 三宅 陽一郎 (著), 山本 貴光 (著), 吉川 浩満 (著)

(感想)

ゲーム、言語、哲学の最新知見から、「信頼」をテーマに、2022年の「AIと人類」の現在地に迫っている本で、主な内容は次の通りです。

はじめに 生活と社会のなかの人工知能 山本貴光

TALK1 三宅陽一郎「世界と知能を再構築する」

エッセイ 人と人工知能の拡張――メタバースとスマートシティ、リアルと仮想を越えて

TALK2 川添愛「意味がわかるとは何か」

エッセイ 〝信頼できるAI〟に向けての課題

TALK3 大澤真幸「無意識が奪われている」

エッセイ 〈無為〉という能力

TALK4 座談会「私たちはAIを信頼できるか」

大澤真幸、川添愛、三宅陽一郎、山本貴光、吉川浩満

BOOKS AIと人類の36冊 山本貴光&吉川浩満

おわりに 吉川浩満

*

「はじめに」には、本書の概要が次のように書いてありました。

「インタヴューパートでは、人工知能と「遊び」「言語」「社会」というそれぞれのテーマについて、ゲームAIの研究・開発に携わる三宅陽一郎氏、言語研究者で作家の川添愛氏、社会学者の大澤真幸氏のお三方にお話しいただいた。いずれのインタヴューも、人工知能という技術と私たちの生活が交わるところで生じる出来事に深く関わっており、読者のみなさんにも参考にあるところがあるのではないかと期待している。加えてお三方にはそれぞれ論考を書き下ろしていただいた。

座談会パートでは、右の三名とインタヴュアーを務めた山本貴光、吉川浩満の五名で「人工知能と信頼」という観点から検討を行っている。」

「おわりに」によると、本書は文芸誌『文学界』の特集「AIと文学の未来(2022年2月)」がベースになっているということでしたが……そのせいか、私が今まで読んできたAIの本とは一味違った切り口が多くて、とても斬新でわくわくしながら一気に読み進めてしまいました。

意見を語ってくれる三宅さん、川添さん、大澤さんの三人はもちろんですが、インタヴュアーを務める山本さん、吉川さんの知的力量も凄く高くて、三人から参考になる話がどんどん引き出され、話の内容に圧倒されてしまいます。以下にその一例を紹介します。

「TALK1 三宅陽一郎「世界と知能を再構築する」」から……

三宅「最近は「リザバーコンピューティング」というニューラルネットワークを使った手法があります。水槽の中で混沌をつくり出し、その中から自分が欲しい混沌を選んで引っ張ってくるイメージです。荒々しいやり方ですが、東洋的な知能の在り方に近いのではないかと考えています。」

「エッセイ 人と人工知能の拡張」から……

「(前略)知能の本質は、世界(環境)と自分の間に一つの循環を作ることです。呼吸や消化がそうであるように、情報や刺激を取り込んで、世界へ向かって働きかける、そして世界からフィードバックを得る、この循環の確立が、学習とか知能とか言われるものです。つまり行動による作用に対して、その反応を予測し、予測した反応に対する行動の準備をしておくこと、が知能の本質の一つです」

「TALK2 川添愛「意味がわかるとは何か」」から……

山本「(文章を自動生成するAIは)人間が作った文章を材料として、言葉がどんな順番で出てくるのかの確率を抽出し、そのパターンや傾向を模倣しているだけ、というわけですね。」

川添「そのとおりです。人間が文章を書く時には、「相手にこういうことを伝えたいから、この話をしよう」と考えますよね。しかし、AIが生成する文章には、そのような意図や表現欲求はありません。AIが書く文章は、人間が書く文章と表面的には似ていても、本質的に違うものなんです。」

「エッセイ 〝信頼できるAI〟に向けての課題」から……

「(AIが偏見を学習してしまう、悪い人間に悪用されるなどの)これらの問題を完全に防ぐことは難しく、むしろ、どうすれば問題を小さくできるかを考えた方が良いように思う。もっとも現実的な方法は、やはり人間が監視をすることだろう。ただし(中略)単純に人間が見ていればよいというものではなく、監視する人間側のバイアスや悪意あるフィードバックによってAIがコントロールされることを防ぐ仕組みを考える必要がある。これは図式的には、フェイクニュースに対抗するためにファクトチェックを公正に行うにはどうすればよいか、という問題に近いかもしれない。最近は公開された情報を用いた調査(OSINT)を行う専門家集団が話題になっているが、AIの監視においてもいずれこのようなスペシャリストが必要になるかもしれない。」

「TALK3 大澤真幸「無意識が奪われている」」から……

大澤「(前略)人間は主観的に自分が思っていることよりも、他者から客観的に言われたことに対して自分を合わせてしまう傾向があるんです。」

大澤「(前略)内面に一切根拠がなくても、客観的なご託宣や宣告や啓示を受けて、客観的に主体化されると最終的に人間はあらがうことができない。

人間が持っている「客観的主体化」への脆弱さに便乗するようなかたちで、ビッグデータが利用されると、だんだん「私よりもAIの方が私のことをよく知っている」と思うようになる。」

大澤「(前略)AIを信じ、従っている分野は今は限られているかもしれませんが、やがてその範囲は広がっていくでしょう。」

大澤「(前略)私たちは常に何らかの行動に実存的な賭けをして、不確かな未来に向けて行動するほかありません。」

「TALK4 座談会「私たちはAIを信頼できるか」」から……

山本「(前略)人間がAIを信頼するには、状況や文脈を共有できなければならない、という課題が見えてきました。」

山本「(前略)人間は信頼のメカニズムをよくわかっていないにもかかわらず、日常的に何事もなければ信頼しあいながら活動していること、そして、そのメカニズムには言語の存在自体が深く関わっているのではないか、ということについて、お話ししていただきました。」

三宅「(前略)AIがこれから社会に対してお告げのように「○○した方がいい」などと言ってくるようになったとき、お告げと現実のズレに対してフィードバック系の制御を取れるようなバックアップを作っておく必要があると思うんですよね。」

*

この他にも、ここに書ききれないほど多数、参考になる話や考えさせられる意見がありました。

個人的には、AIへの信頼は、「プログラム」への信頼より低い状態です。機械学習や深層学習は、設計者にも分からない結果を返すことある「ブラックボックス」の性質があるからです。もしかしたらそれは、そもそもAIが、人間のニューロンを模倣したニューラルネットワークで出来ているからなのかもしれません。だからAIを無条件に信頼するのは危険だと思います。

それでも実用レベルに至っているAIは、少なくとも「人間並みに」信頼できるとは思うので、時々「間違っていないか」チェックしつつ、付き合っていけばいいのではないでしょうか。

本書でも、川添さんが「ファクトチェックと同じような仕組み」、三宅さんが「ズレにフィードバックする仕組み」について語っていますが、今後は、それが必要になると思います。

そしてこの考えを増強してくれたのが大澤さんの

「(前略)そんな私たちの前にAIは、私たちが何をすべきか、「答え」を教えてくれる存在として出現します。」

という意見。社会の変化スピードが速くて迷いが多い私たちは、放っておくと、これからどんどんAIへの依存を強めてしまうような気がします。そうなる前に「AIは無条件に信頼できるものではない」ということを私たち人間の「常識」にしておくべきではないでしょうか。

とても面白くて勉強にもなる本でした。

最後には「BOOKS AIと人類の36冊」として、山本さんと吉川さんが、このインタヴューと座談会の内容にも関連する本を紹介してくれます。どの本もとても興味深い感じで勉強にもなりそう。読んだことのない本も多かったので、これから少しずつ読んでみたいと考えています。

ぜひ、みなさんも読んでみてください。お勧めです☆

* * *

なお社会や科学、IT関連の本は変化のスピードが速いので、購入する場合は、対象の本が最新版であることを確認してください。

Amazon商品リンク

興味のある方は、ここをクリックしてAmazonで実際の商品をご覧ください。(クリックすると商品ページが新しいウィンドウで開くので、Amazonの商品を検索・購入できます。)